用gemini和夸克识别了一遍。因为gemini 2.5 pro关闭了免费等级的原因,部分内容用2.5 flash的结果,flash整体错误率是高于pro的,不过快很多。 另外缺页检查补了部分数据用的是 gemini 3,没有检查幻觉问题,如果有大量幻觉还需要补数据。

另外我已经从app中提取了数据,但是本地的数据不全,只有索引,第一个解释和例句。html需要从网站抓取,但需要账号而且抓取11万条数据容易被封号,所以我准备还是用ocr方法来做这本词典,但音标这种ocr容易错的可以直接用app数据。另外app有等级标注,这部分数据不知道是哪里来的。

新世纪法汉大词典_gemini.txt (20.0 MB)

新世纪法汉大词典_quark (2).7z.002 (1.1 MB)

新世纪法汉大词典_quark (2).7z.001 (20 MB)

而且官方app也不代表数据就是对的,就算只用音标都可能反而把识别结果改错,举例:

4 个赞

用 Gemini CLI,实际还有相当的免费额度,但它不容易准确控制。

可以传文件,可是怎么传,怎么处理,就看模型的心情了,自己不容易精准把握。等于托人办事,加了一个代理,但这个代理具体怎么来,并不由你掌控。

我曾经在文件夹里放了一些图片,让它批量ocr,存为同名txt,gemini cli照办了。但有时是乱来一气,没有结果。稍微尝试之后,我就没怎么用过了。

我试了下发现效果还不错,准备写个脚本自动调用。

不过前面会输出思考过程,测试了《新时代大俄汉词典》:

新时代大俄汉词典_1.txt (215.5 KB)

1 个赞

格蕾特

6

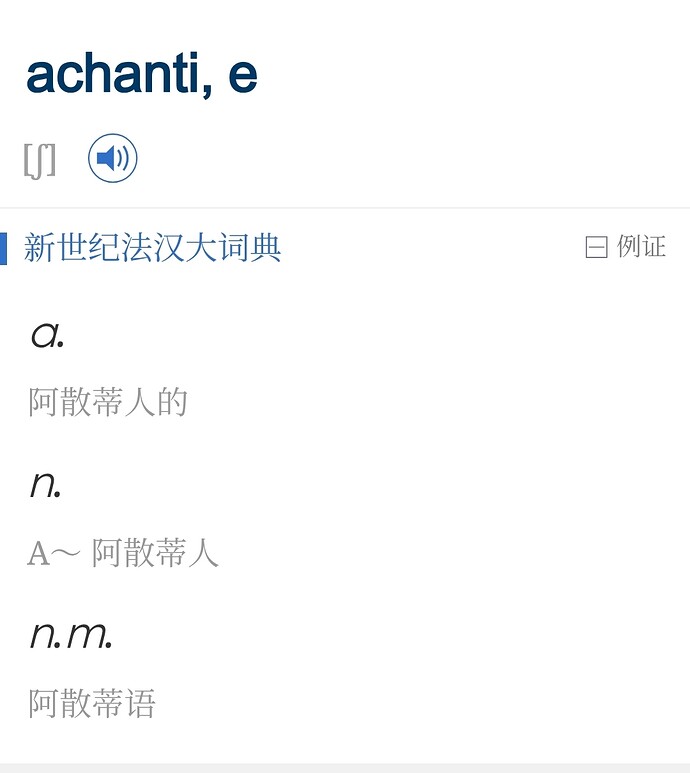

这里应该是修改了,achanti 英文是 ashanti,肯定不会读 [k],所以 app 算是把错误的音标改正了。

1 个赞

官方app里面截图就是下面那个,只有[ʃ]说明他们提取数据有误,把整个读音部分都丢了。

格蕾特

8

啊因为有些词典只会在读音可能有争议的地方标音,比如只标词尾,所以我一开始以为没有问题。要是这本词典里其他单词的音标都是标完整的,那这里就确实应该是提取错了。

补充paddleocr识别的文本

xsjfh_paddleocr.7z (19.1 MB)

![]()