而且3万多收词量对于广泛的英文阅读来说根本不够用,查得率较低,是native speak中学生的水平。

我之前也有过类似的构想,不过是针对汉语词典而言的。但同理有几个很现实的问题需要考虑到,即便开发的是一部面向大众、不以盈利为目的的开源词典,也必须以一个产品经理的角度来思考这几个问题——这个开源项目是否具备可持续性、可发展性、可利用(参考)性、可扩展性,最关键的就像Vim君提到这个项目是否有一个专业、稳定的团队,一方面在平台搭建、数据存取、技术维护发力,一方面在文本编、译、审、校等环节发力,尤其是编译审校方面,即便前中后期可以最大化榨干AI的辅助能力、多方吸纳热心学友的建议,但还是需要有专人进行持之不懈的把关、鉴衡,保证收词释义引例等不失范(走样)、脱焦。我想现在目之所及的几个个人或少数人仍在维护的项目未始一起头就是个人英雄主义的产物,只是同样在寻人、留人、用人方面犯了三难,最终不期然而然沦为所谓的个人英雄主义的产物。在这个知识信仰失坠的时代,知识人(也即潜在的知识共享平台项目的知识利用者、创出者)更考虑的是如何有尊严地活着,必然世俗化地走向求名、求利二途,而不以名利为期的知识共享项目大概难入其眼,或者即便有心,也难以风雨如磐之心始终从事。

这些问题我考虑过,应该不是什么很大的障碍。

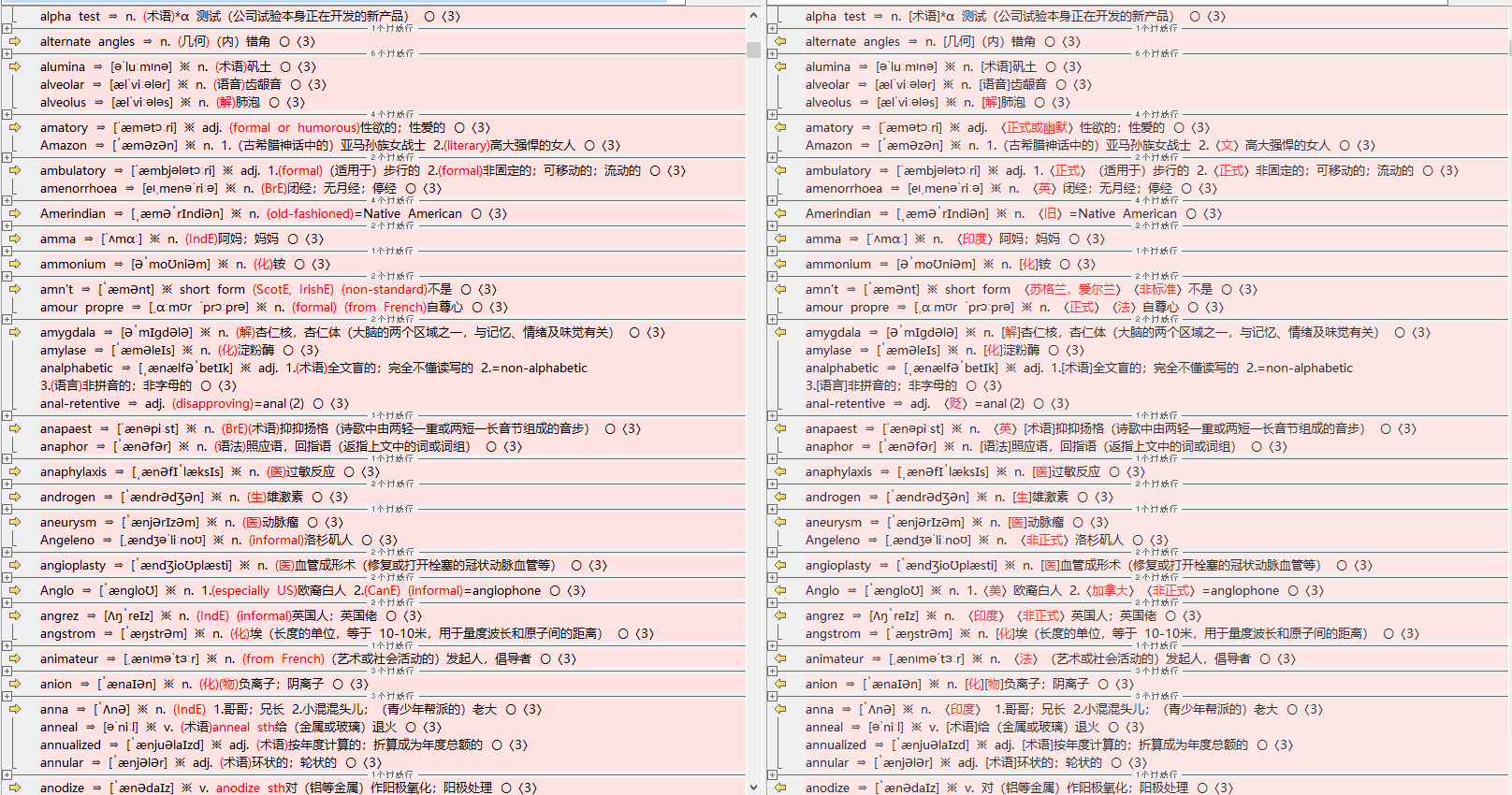

1,词典有近中远三个目标,最基本的是做一个释义简明且可靠的中等数据库。简明精炼这一条通过合并三个不同等级的词典来实现,最基础的2-3万基础词汇用小词典,下来的1万词用另一个稍大的词典,再剩下的5万词用ODE,这样可以避免繁芜累赘的问题。像《英汉大词典》一个 look 释义几十项,我个人觉得没什么必要,特别在用于速查的情况下。释义准确可靠这一点,作为起点的原始底稿也是有保障的,因为它就是复制、复刻数本久经考验的常用词典。有错误也主要是因为经过了多次数据转换引入的,存在用技术手段批量检验的可能。

2,中期目标是检查错误,统一体例,稍微麻烦一些。正则、编程,加上ai辅助,难度也不大。

3,远期目标是通读审查,编辑修正释义文本,争取获得独立的版权。它不求一日之功,可以三、五、十年来干。如果我15年前发起类似的项目,可能早就完成了,但没有,同样这15年内也没有别的救世主出现来给大家施恩。假如今日不勉强开始,也许5年、10年后还是没有一本开源免费准确的英汉词典,那可真成了一种文化上的耻辱了。

4,从可操作性,manageability上考察,我并没有雄心壮志去做一本25万、50万词,遑论400万词的数据库。我的定位是10万词,够用,同时不失控,没法管理,而且它是简明释义词典,不处理繁琐的语法、例句、写作时使用等问题。在这10万词当中,其中大概有5万词属于生僻难词、专业名词,语义按惯例照录、确保无误即可,真正需要费心照管只有4-5万个词汇。

5,4-5万个词汇没那么吓人,我早年通读过的若干词典都到了这个量级。如今我日常阅读也是以英文为主,顺手检查校改若干单词是很方便的事情。

6,这个项目即使失败了,半途而废,或者我的兴趣以后彻底转移,也已经有一个释义简洁且相对准确可靠的10万词英汉词典数据库存在于网上。

不管什么项目,最好的时机是生态空白时,要在成熟的生态中从零造轮子,不仅要证明自己足够好,更要解释为什么世界还需要另一个轮子。

我发现漏看了这一节,原来你是想对旧有多种词典的义项进行归并再删繁就简,这样做倒也无妨,似乎跟楼上shiruxue列举词典多功能百宝箱功能有点重合,都讲究速查特点,如果能后出转精倒也值得期待。但这类词典受众面岂不是很窄,一个开源词典项目如果受众面狭窄,是否也意味着用户与用户之间、用户与开发者之间的知识环流(知识互动)效能会降低许多。

我不觉得跟多功能百宝箱等有什么重合,在我的眼里,那些释义来源是有道、海词等网络资料的词典是不可信也不可用的,错误不谈,光是为了遮掩抄袭痕迹把义项顺序打乱、合并等就犯了大忌。很多词典都是以常用义、次常用义、罕见义等顺序排列义项的,你不能随便颠倒或者更改;合并也是妄为,如果真的可以合并,词典编撰者也没必要费事再列义项了。

我多年前写过一个程序,是给英文文章自动加生僻难字的行内中文注释。那些什么牛津高阶,ODE自然没法在这种情境里用了,释义文本过长,喧宾夺主。想找一个合适的简释英汉数据库,结果都是鱼龙混杂,不知道哪里来的野鸡货,基本没法用。由此才生发自己编辑整理一个可靠的英汉简释词汇表或者词典的念头。

自己重新编一个英汉词典,那可是大工程,不是我的志向和兴趣,而且在如今各种词典泛滥过剩的情况下,我想不出来有什么新意和必要。我自己实际上日常用词典都比较少,顺手Google,查得率和方便程度那比特定词典强多了,我对语义的理解也是以实际用例为主,不算太认可或者迷信各种词典的权威。

有没有受众我不太关心,首先是我自己可能用得上,顺道继续学习英语,其次,它也许是喂给未来的ai做训练数据的,是机读而不是人读。

还有一种可能,不等我把这个词典整理明白,大家就已经不需要别人编的词典了,写一个prompt,说清楚自己的需求,ai自动生成各种量身打造的词典,而且准确性颇高。这是很有可能的,musk就用ai生成了90万词条的grokipedia,完全符合自己的意识形态立场和趣味。

对头,AI在这方面有着天然的语料优势,尤其是英语语料更是如此。我试着用gemini、chatgpt就某些习见的英文词语详释文化意涵、罗列名言警句、解析用法细节,当真是独一档

释义来源于有道、海词,保证了一定的可信度。站在巨人的肩膀上不比重新搭脚手架强?两种语言之间不可能一一对应,语境不同语义也不尽相同,多功能百宝箱的义项附带词频,便于查询者从中选择。如果重编一本“词典”,像倒澡盆里的水连孩子也一块倒掉了,那还有什么意义呢?

真是不知所云,参考我前面的回复。

你所描述的目标,需求场景是非常丰富的。补充几个我真实的需求场景:

-

小朋友学习非常有用。小学生第一次学习时,经常需要查字典,他们看到现有大部分学习型词典的长篇大论是完全没有耐心的,非常需要一个权威又简洁的版本。曾经花了点精力装修 Oxford Primary 这个词典,但是它的词汇量非常有限,义项也有限,真的就仅适用于小学生。曾经一度也参考 skywind3000 开发的 单词释义比例,很有创意,但其中也暗藏了很多问题,不太敢给小学生使用。

-

电子书或手机中使用。那些长篇大论的词典不太适合使用这些小屏(手机)、慢速(电子书)的情景,非常需要一个简洁、权威又有足够覆盖度的版本。COD9 挺好,但还不够好。

-

程序化加工词典。喜欢的各种词典,由于结构复杂,比如COD9,它并非 html 标签,而是 xml 一样的自定义标签,这给程序提出了新的挑战,比如使用 mdxscraper、ANKI等,默认无法正确提取它的词条。

-

作为 AI MCP 的数据源,各种场景使用。

一旦有了这个开源词典,那些大厂一定会乐疯,并偷偷使用。或许可以找它们赞助。

其实,最最最应该承担这个责任的是政府部门或大学的什么机构,它们有专门的词典计划,但那些当政者并不关心“开源”这种东西,巴不得卖个千八百万。相比之下,我觉得台湾在词典开源方面真正做了一点事。

![]() ,关注了!

,关注了!

除了主词典,是否可以考虑采用分支的方式独立维护专业词典?这样不同的专业人员就可以贡献这部分内容,用户也可以按需挑选。类似输入法的各种词库。

这个设想不错,但也是未来的议程了,目前主要任务是保证词典内容正确,体例大致统一。

COD9我以前提取过纯文本,以及中文释义,但用的底本是比较旧的mdx词典。现在用 endnote 修正过的版本 (牛津现代英汉双解词典(第9版)双解切换 2022-10-18 )重新提取了一遍中文释义,效果比以前稍强一些。

COD9-中文释义.txt (8.6 MB)

COD9的释义同属简短精炼风格,处理了以把它作为备胎之一。

我把提取用的script也贴一下,可以按照自己的目的、需要随意改造。

extract_cod9.py (3.8 KB)