这个软件有办法解决上面我说的那个问题吗?

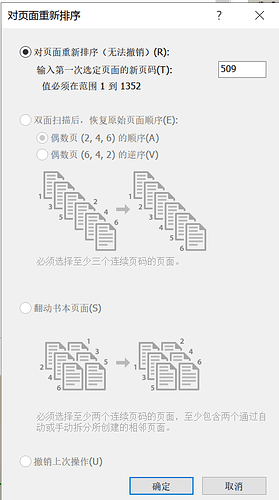

如果OCR的时候每一页的内容可以保存到单独的一个文件,那这个问题就可以解决。把左边的PDF OCR后的结果放在一个文件夹里(就是一堆文件),右边的结果在另一个文件夹里,然后用程序在两个文件夹里分别依次取文件。

对比了下还是原PDF的识别效果更好, 包括一些易错字母,长短连字符,分号等准确度相对更高。

长短连字符识别准确感觉挺重要的, 短连字符用于换行,方便用正则处理掉,避免mdx里单词被切成两行。

也许可考虑先用ComicEnhancerPro之类的增强下图像,再做OCR效果能更好点。

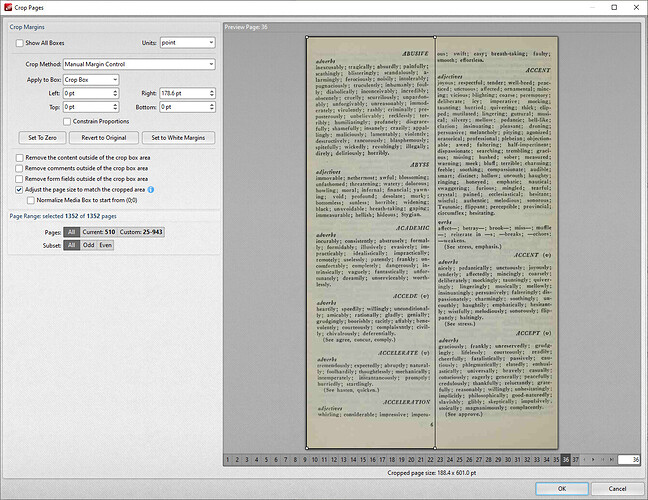

这个也能做到左右切页,然后重命名

ABBY 按行左右切分,有的页面文字给切残了。这个笨办法行不通。

ABBYY有个重新排序功能, 可以将识别出来的区域按从左到右, 从上到下的方式排序, 再识别文字。 不过似乎只能用于当前页, 不知道是否能批量操作。 重新排序后,识别出来的文字就没了之前的问题了。

菜单里有绘制区域,区域模板保存、加载功能,不知能否用于批量处理。

能批量。英文书ocr 还是首选ABBYY。跨行-隔开的单词、段落合并等等处理比其他软件好。

我的需求是,识别结果能保留斜体格式。不喜欢docx 格式,因为后续不好加工。希望是保留斜体格式的md文件,但没看到这种软件

发现ABBYY功能挺强的,pdf识别可以纯OCR、在OCR和pdf文字间自动判断、只使用pdf文字,OCR可以训练识别新字符和连字,训练时可以手动指示是粗体、斜体、上下标等。输出html时也可以保留斜体、粗体等格式。

尝试训练后识别, 基本无错, 包括连字。

Syn Finder (1978) 處在網路之前的時代,“wireless” 還指 “radio” 呢。 (“radio” 詞條)

其中一個詞頭是 “xerox” — 想想當時…公司做得很大,現在被淘汰了,很少人說“xerox”表示“copy”。光出現在釋文就應該表是“Obsolete”了,何況當做單獨一個詞頭。

但老東西也有價值,Syn Finder 存了很多“Literary”書面語,拉丁語,外來語,看學術或文學會常見到的東西。

也有些因為遙遠而覺得古怪的,例如 “mister” 詞條,其中一個同義詞是“Hindustani: sahib.”

據OED: “sahib: A respectful title used by the natives of India in addressing an Englishman or other European (= equals ‘Sir’); in native use, an Englishman, a European.” 也就是說,是英帝國主義的古董。

牛津“更新”的字典,例如ODE,只不過不好意思說這個詞的背景,只說是“(in India) a polite form of address”(哈哈,既然是印度用語,為什麼英文字典要收?),等於是掩蓋這個歷史。這種“更新”不算是進步。

可以看看效果—總共有43,000的詞,自己沒有詞頭,只出現在釋文中。

都分配了跳轉;免得搜尋結果繁雜,限制每個詞 只跳一個地方。其實,大多數的 在很多不同詞條裡出現。

43,000 links SynF.zip (400.4 KB)

谢谢分享!大神可否把word finder也转成mdx?

謝謝您,但不太理解等號後面的數字,是相關度嗎?還是頻數呢?可否指點迷津…謝謝啦!

| abduce | @retract | =00.03 |

|---|---|---|

| abeam | @aside | =01.03 |

| abecedarian | @probationer | =00.03 |

| abecedarium | @schoolbook | =00.04 |

| abecedary | @manual | =00.07 |

| abed | @supine | =01.07 |

| Abendmusik | @nocturne | =00.04 |

| aberrance | @anomaly | =01.03 |

| aberrancy | @anomaly | =01.04 |

| aberrantly | @erratically | =02.15 |

| abetment | @backing | =01.03 |

奇数和偶数页使用不同的切分位置,是否能做到不残? 真希望有个自动内容识别进行页面定位的功能,页面不能完全对齐,处理起来确实比较头大。

號碼是為了處理duplicate。例如,"abduce"出現在三個詞條 ------ 怎麼判斷應當跳到哪個詞條?

abduce@retract=00(這個"retract"的釋文不分號碼)

abduce@withdraw=01("withdraw"的第一個釋文組)

abduce@abduct=03("abduct"的第三釋文組)

理論上,出現在第一個釋文組就最接近詞目的本義。按這個原則,"abduce"最接近"retract"或"withdraw"的本義;第三個選擇可以排除。應當選“abduce@retract=0”(不分號的釋文組沒有意義的分歧,所以 0 勝於 1)。所有43,000詞是這樣分配跳轉目的地。

做法很簡單,先排好每行三欄,再Delete Duplicates,條件限制於第一欄,就會刪掉下面兩行了,留下abduce@retract=0。

第二個號碼,是釋文系列中的排次位置(不算有詞頭的詞)。“abduce@retract=00.03”就是釋文中的第三位置。一樣的道理:排在前面的應當更接近詞目的本義。

Mastameta 兄,對於Thesaurus有相當的研究呀,厲害了,對於用@@@LINK這個方式來跳轉雖然方便但卻有些許的不足,只知道用 a href 來跳轉會好些,但也感覺不是很好,也一直沒有更佳的處理法,這是一本很好的 thesaurus 但若排版因素導至查尋功能,或顯示的方式不足,往往打折一本很好的素材,但這卻又往往令人頗費心思,因除了美觀外,功能上提升的背後是跟隨著一大堆的處理

@@@LINK 跳轉讓使用者找到相關的詞條。然後,釋文中的同義詞,如果是詞頭(本身有詞條),就會帶 href="entry://… 的連接。

跳轉與連接,互相補充作用。雖然限制於MDX的功能,我覺得這樣也夠了。

經仁兄點撥,似乎觸發了新的不同的想法,或許是可行的方案,只是檔案會變大許多,但效果是否能如預期所想的則需實現後感覺才能得知,謝謝啦!